Acid2

Gestern^WLetzte Nacht habe ich

auf einen interessanten Webdienst hingewiesen der einem

Webseiten zu PDF konvertiert. Letzte Tage habe ich bei der Arbeit noch Gelegenheit gehabt mich darüber zu wundern wie der IE8 beim

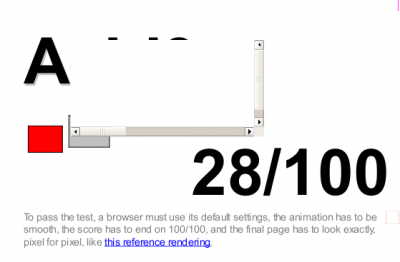

ACID3-Test abschneidet (Wer keinen IE zur Verfügung hat kann sich Beispielergebnisse in der

Müllhalde ansehen). Also liegt es nah, auch diesen Dienst mal damit zu penetrieren…

Acid3

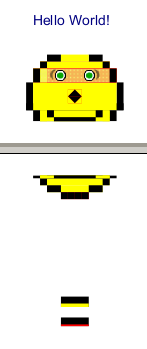

Während ich mich beim aktuellen Windows-Browser über 20 von 100 Punkten lustig machen konnte bringt es dieser Dienst immerhin auf 28. Der Firefox an dem ich gerade sitze schlägt sich wacker mit 94 von 100 Punkten. Acid2 schaffen aktuelle Browser eigentlich ohne großes Aufsehen, auch hier zeigt der Dienst aber schwächen: dass der Smiley auf dem Seitenumbruch landet kann man nicht kritisieren. Wohl aber, dass er eine Brille hat die irgendwie an den Visor von Commander Geordie LaForge erinnert.

Nochmal in der Wikipedia nachgesehen, da entspricht die Ausgabe am ehesten dem Bild das MobileSafari erzeugen würde.

Irgendwie ist das aber auch kein Wunder. Die PDF-Ausgabe von pdfmyurl.com sagt in den Properties dass sie mit einer Software namens wkhtmltopdf gerendert wurde. Das ‚wk‘ im Namen deutet darauf hin dass dieses Tool (und somit der Webdienst) genau wie Safari mit Webkit arbeitet.

Langer Rede kurzer Sinn: Dass das Ding die Acid-Tests nicht mit fliegenden Fahnen besteht ist schade, aber zu verschmerzen. Viel wichtiger ist: ich habe mit wkhtmltopdf ein neues Tool kennengelernt das mir vielleicht nochmal nützlich sein kann. Und wenn jemand bis hier durchgelesen hat, nicht nur ich.

Heute hat Excel mich irgendwie an das Stück ‚Gleichzeitig? Das kann ich nicht‘ von

Heute hat Excel mich irgendwie an das Stück ‚Gleichzeitig? Das kann ich nicht‘ von